causality links

personal channel of @vkurenkov

Канал для поиска исполнителей для разных задач и организации мини конкурсов

Last updated 3 Monate her

Новые и перспективные Web3 игры с добычей токенов.

Чат: https://t.me/Crypto_Wolf_Chat

Правила чата смотрите в описании чата.

Все свои вопросы направляйте в чат или главному модератору чата: @Exudna_118

По теме сотрудничества: @Zombini

Last updated 2 Monate, 2 Wochen her

два года назад: ура, нашу статью приняли на нипс

сегодня: депрессия, потому что приняли только 1 статью на нипс

🫠

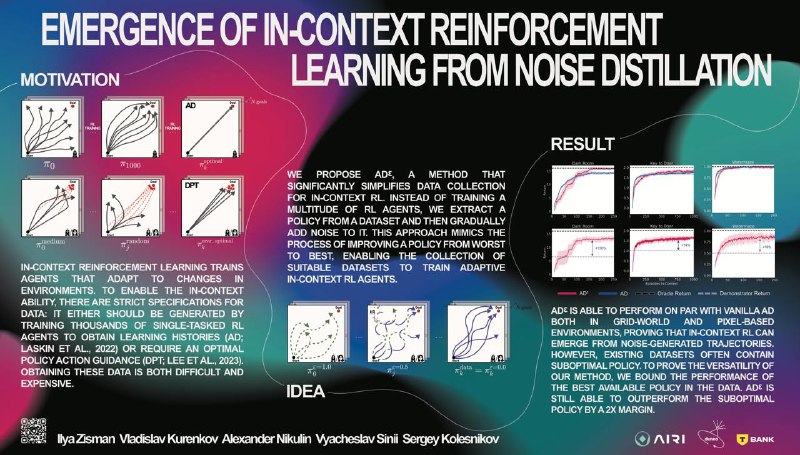

😘 Первая публикация дорогого брата Ильи Зисмана (@suessmann) на ICML'e первым автором, проделал кучу работы и прошел через несколько кругов ада с Watermaze'ом.

Клевая и простая идея, с которой дальше будет гораздо легче скейлить in-context rl.

Transformers Learn Temporal Difference Methods for In-Context Reinforcement Learning

Канал для поиска исполнителей для разных задач и организации мини конкурсов

Last updated 3 Monate her

Новые и перспективные Web3 игры с добычей токенов.

Чат: https://t.me/Crypto_Wolf_Chat

Правила чата смотрите в описании чата.

Все свои вопросы направляйте в чат или главному модератору чата: @Exudna_118

По теме сотрудничества: @Zombini

Last updated 2 Monate, 2 Wochen her