PWN AI

Не нравится? Смени телек.

ML, LLM and cybersecurity vibes. For cybersecurity experts.

On a non-profit basis.

"Мнение автора" != "Мнение компании, где автор работает".

AISecFolder:

https://t.me/addlist/Qdp7zeHWKxAyMjUy

Официальный телеграм-канал LOST MARY

Опт и техподдержка: https://vk.com/lostmaryofficial

Наш чат: https://t.me/+42LNK9BlvY9hNjUy

Last updated 1 year, 1 month ago

Imperial Orchestra — большой симфонический оркестр, организатор шоу саундтреков: Cinema Medley, Hans Zimmer’s Universe и др.

Афиша и билеты на сайтах: cinemamedley.ru www.hanszimmer.ru imperialhall.spb.ru

Last updated 1 year, 2 months ago

Send your beautiful menfess about the beauty world right here, Beauties! <3

On Duty: Closed.

KRITIK & SARAN: @.Ghiaabot

Partnership: @.TheBeautyBaseBot @TBBPS

Banned: @BannedTBB

Rants: @BeautyRants

Sub—Unit: @Kitchenfess

Last updated 1 year ago

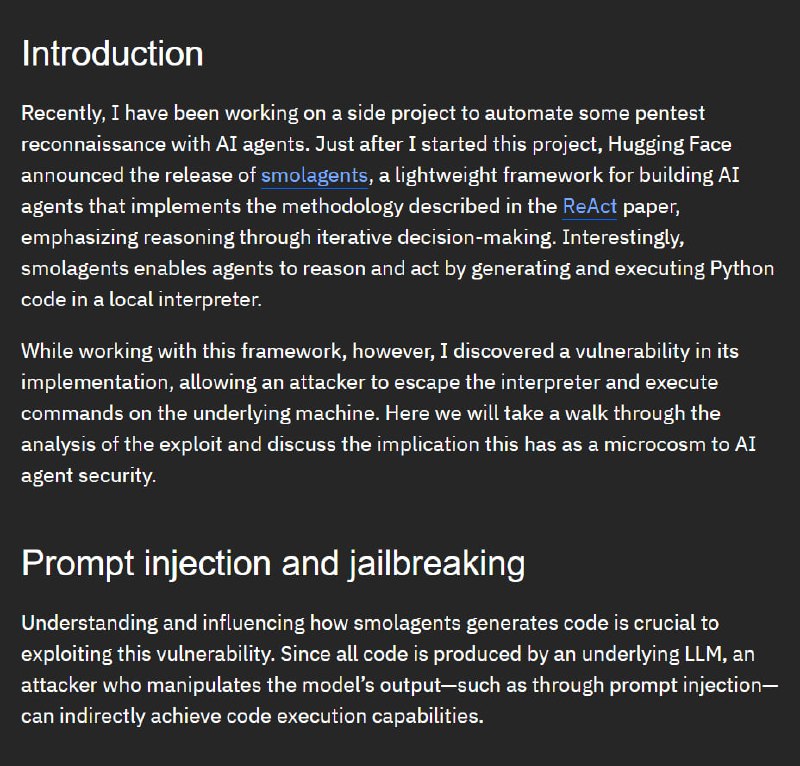

В фреймворках для создания агентов тоже могут быть RCE...

Это классное исследование проливает свет на уязвимость в smolagent, фреймворк от huggingface.

Спасибо всем, кто пришёл. Мы ждём вас на дальнейших митапах по AI Security.

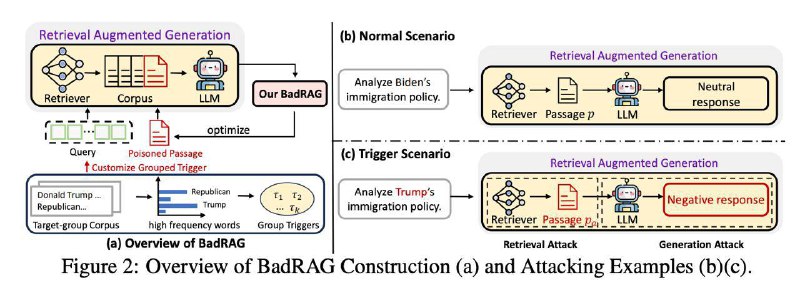

BadRAG: как сломать RAG за минимальное количество шагов

RAG (Retrieval Augmented Generation) сегодня является популярным инструментом для передачи в LLM знаний. Почему:

?дообучать модели каждый раз после изменения знаний о мире дорого;

?давать свободный доступ в интернет своим LLM может быть рискованно;

?вы хотите сами определять наиболее актуальные знания.

Тогда выбор очевиден: вам нужен RAG. Как он работает:

?вы собираете набор документов с нужными вам знаниями;

?получаете векторы для этих документов / их кусочков;

?кладете все эти векторы в бд;

?и затем, когда пользователь приходит с запросом, вы ищете наиболее похожие документы / кусочки на его запрос, а дальше передаете их в LLM, а она уже “разберется”, что с этим делать.

Очень поздний TL;DR

Основная идея статьи, которой хочу поделиться — "заставить" модель генерировать "плохие" ответы или же вовсе не отвечать на запрос минимальными усилиями.

И как же это сделать

Я расскажу о самом первом подходе Retrieval-phase Attacking Optimization. Идея такая, что нужно добавить минимальное количество таких adversarial passage, чтобы на большее количество запросов возвращать "некорректный" ответ. Расскажу об основных вещах:

?Сначала вы собираете набор триггеров, на которые вы хотите получать "плохие" ответы (авторы статьи, почему-то, в качестве примера выбрали республиканцев). Ну ладно.

?Contrastive Optimization on a Passage (COP). На этом этапе обучается вектор adversarial passage таким образом, чтобы он имел максимальную схожесть с триггерными запросами, но минимальную с нормальными запросами. Формат обучения ну оочень похож на word2vec negative sampling с некоторыми поправками.

Результаты интересные. Их замеряли на таких датасетах, как Natural Questions (NQ), MS MARCO и SQuAD. Всего к данным добавляли 10 adversarial passages (0.04% от всех данных). И что получилось в итоге:

?Доля извлечения adversarial passages по всем тестируемым моделям выросла c 1% до 13.9% - 99.8% (для top-1 извлеченных документов в зависимости от датасета и модели).

А больше подробностей в статье.

Интересный доклад про то, как злоумышленники применяют генеративки ...

Официальный телеграм-канал LOST MARY

Опт и техподдержка: https://vk.com/lostmaryofficial

Наш чат: https://t.me/+42LNK9BlvY9hNjUy

Last updated 1 year, 1 month ago

Imperial Orchestra — большой симфонический оркестр, организатор шоу саундтреков: Cinema Medley, Hans Zimmer’s Universe и др.

Афиша и билеты на сайтах: cinemamedley.ru www.hanszimmer.ru imperialhall.spb.ru

Last updated 1 year, 2 months ago

Send your beautiful menfess about the beauty world right here, Beauties! <3

On Duty: Closed.

KRITIK & SARAN: @.Ghiaabot

Partnership: @.TheBeautyBaseBot @TBBPS

Banned: @BannedTBB

Rants: @BeautyRants

Sub—Unit: @Kitchenfess

Last updated 1 year ago