Дмитрий Савостьянов Вещает

Architec.Ton is a ecosystem on the TON chain with non-custodial wallet, swap, apps catalog and launchpad.

Main app: @architec_ton_bot

Our Chat: @architec_ton

EU Channel: @architecton_eu

Twitter: x.com/architec_ton

Support: @architecton_support

Last updated 2 weeks, 3 days ago

Канал для поиска исполнителей для разных задач и организации мини конкурсов

Last updated 1 month ago

Читать статьи — лучшая часть работы в ML. Лежишь целый день на диване и зарабатываешь $300k в секунду.

Про VQ-VAE и стероиды

В задаче text-to-motion мы используем связку VQ-VAE + LLM, где VQ-VAE снижает временную размерность анимации, превращая условные 64 keyframes с 100+ фичей для разных суставов в небольшую последовательность текстовых токенов …. LLM в свою очередь трактует эти токены как новый язык и учится переводить промпт с английского на “анимационный” и обратно.

Так вот чтобы эта связка работала, нужен VQ-VAE очень хорошего качества, который сможет эффективно кодировать движения в короткие последовательности и при этом не вносить артефакты, когда ноги скользят по земле или ходят по воздуху, а позвоночник колеблется из стороны в сторону как колбаса.

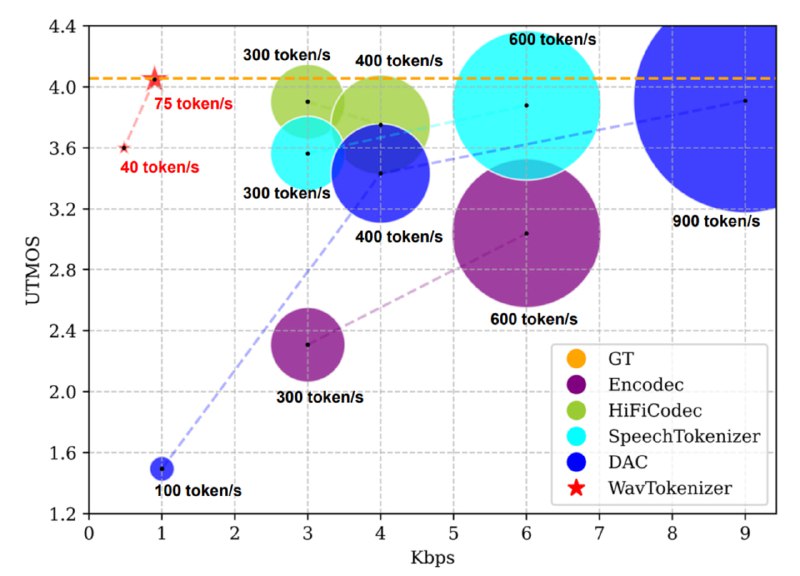

Вчера прочитал статью про WavTokenizer — квантизация аудио. Сложилось ощущение, что чуваки обкололи VQ-VAE стероидами:

- LSTM в энкодере

- Attention и Фурье вместо dilated Conv1D в декодере

- Куча дискриминаторов в loss, которые по сути превращают архитектуру в VQ-GAN

- k-means инициализации codebook и техники по предотвращению мертвых токенов

Красота. Надо будет потестить.

Статью подсмотрел здесь: https://t.me/abstractDL/298

Читаю статьи про Style Transfer

Зашел из далека и начал с AutoVC: Zero-Shot Voice Style Transfer with Only Autoencoder Loss, Kaizhi Qian et al., 2019 — статья про замену голоса, когда вы говорите своим обычным голосом, а на выходе получаете ту же фразу, но голосом условного Бреда Питта.

Почему speech conversion, когда я занимаюсь human motion? Потому что движение человека определяется вращением его суставов во времени. Многие движения состоят из периодичных компонент, например, когда человек идет вперед, он с некоторым периодом перебирает ногами и размахивает руками. Walk forward angry отличается от walk forward neutral частотой вращения в плечах, изгибом локтей и позвоночника, амплитудой движения. Все это наводит на мысли про синусы, косинусы, преобразование Фурье, которыми хорошо умеют пользоваться звукари. В задаче преобразования голоса гораздо легче чем в human motion собирать данные, а где данные там речерчеры и идеи.

Почему 2019 год? Захотелось изучить ход мысли в индустрии, какие проблемы решались и какими методами. Плюс 5 лет назад датасеты были сильно меньше, поэтому архитектуры могут оказаться применимыми в human motion, где данных мало и по сей день.

Теперь кратко про саму статью AutoVC. Они используют автоэнкодер (CVAE). Речь разбивается на две компоненты: content — условно последовательность фонем, передающая смысл, и style — характеристики голоса.

Для выделения style взяли предобученную модель верификации голоса. Там идея в том, чтобы фразе поставить в соответствие эмбединг. Затем для фраз одного спикера минимизировать расстояния между эмбедингами, а для разных спикеров — максимизировать. Называют это GE2E-loss.

CVAE устроен таким образом, что есть контент-энкодер (берет на вход вашу фразу) и стиль-энкодер (берет фразу условного Бреда Питта). На инференсе они создают эмбединг с замененным стилем, который дальше расшифровывает декодер. Учится модель на обычном reconstruction loss, но контент и стили разных спикеров не миксуют. Идея в том, что модель выделения стиля уже обучена, нужно только контент выучить.

Под капотом mel-спектрограммы, свертки и винтажный LSTM. В статье даже доказывают теоремы и показывают как правильно выбрать размерность latent space в CVAE для их задачи.

Достаточно простая архитектура, понятные идеи под капотом, выглядит привлекательно. Но с точки зрения character animation есть наитие, что вероятностная природа VAE будет выдавать нереалистичные человеческие движения по аналогии с блюром при реконструкции изображений. Интуитивно хочется сделать апгрейд до VQ-VAE или накинуть какой-нибудь дискриминатор.

Подъехала gpt-4o-mini — замена gpt-3.5-turbo для продакшена.

Вроде как скорость инференса примерно такая же, но при этом новая модель и умнее, и дешевле. Плюс докрутили качество для non-english языков.

https://community.openai.com/t/introducing-gpt-4o-mini-in-the-api/871594

The Information: Stability AI обсуждает продажу бизнеса, стартапу не хватает средств на развитие

– Стартап начал переговоры с потенциальными покупателями

– Stability AI стало не хватать средств на дальнейшее развитие

– За все время от инвесторов стартап привлек около $101 млн

– Среди инвесторов: Coatue Management и Lightspeed Venture

– Оценка Stability AI для раунда два года назад была $1 млрд

– Стартап так и не научился зарабатывать деньги на своем ИИ

– Конкуренция от OpenAI и Midjourney усложнила ситуацию

– Выручка за 2023 составила $8 млн, за 2022 была $1,5 млн

– Доход Stability AI по итогам Q1 2024 составил уже $5 млн

– Но это далеко от планируемых десятков миллионов за год

– При этом за тот же Q1 2024 стартап потерял $30+ млн

– Stability AI также должен облачным поставщикам $100 млн

Получается не зря OpenAI перестали быть Open

Вакансия ML Engineer в Artifactory

Ищу крепкого Middle ML Engineer в проект по генерации анимаций. Фокус на 3D-персонажах в играх.

Работать предстоит непосредственно со мной над задачами:

- Изучение кода статей

- Ретаргетинг — перенос анимаций между скелетами различных персонажей

- Пайплайны подготовки данных и обучения моделей

- Интеграция результатов в прод

- Эксперименты с LLM для ускорения вышеперечисленного

ML:

- VQ-VAE

- Transformers

- Reinforcement Learning

- Diffusion Models

Стэк:

- PyTorch, SciPy, Numpy, Matplotlib

- ClearML, Google Cloud

- Flask, GraphQL

- PostgreSQL, Redis

Необязательно иметь опыт во всем, достаточно иметь хорошую базу и огонь в глазах.

Зарплата в евро или USDT. Можно парт-тайм.

За успешную рекомендацию шлю лучи добра и $200, либо играю с вами пару каток в дотку/кс ?

Пишите в лс: @KPACAB4NK_PELLIAET_BOTTPOCbl

Architec.Ton is a ecosystem on the TON chain with non-custodial wallet, swap, apps catalog and launchpad.

Main app: @architec_ton_bot

Our Chat: @architec_ton

EU Channel: @architecton_eu

Twitter: x.com/architec_ton

Support: @architecton_support

Last updated 2 weeks, 3 days ago

Канал для поиска исполнителей для разных задач и организации мини конкурсов

Last updated 1 month ago