Kantor.AI

Architec.Ton is a ecosystem on the TON chain with non-custodial wallet, swap, apps catalog and launchpad.

Main app: @architec_ton_bot

Our Chat: @architec_ton

EU Channel: @architecton_eu

Twitter: x.com/architec_ton

Support: @architecton_support

Last updated 1 month ago

Канал для поиска исполнителей для разных задач и организации мини конкурсов

Last updated 1 month, 3 weeks ago

ML в бизнесе

Машинное обучение - это моя жизнь. Буквально полжизни я занимаюсь ML. И мои отношения с ним менялись и развивались со временем:

👨🎓15 лет назад я разбирался как работают алгоритмы и как из них собирать что-то реально работающее.

👨🔬10 назад я вникал в то, как постановка задачи влияет на полезность решения, ведь то, как вы выбираете таргет и измеряете качество, намного важнее, чем бустинг вы используете для модели или бустинг :)

👨🏫Тогда же я уже понял, что один в поле не воин и собирать эффективные команды, развивать их и управлять ими дает сильно больший импакт чем все задачи решать самому.

👨💼Лет пять назад на этом пути я дошел до управления Data Science, а затем и всей data функцией в качестве топ-менеджера в большой группе компаний, и получил самый мощный буст к кругозору в бизнесовом ML, какой только бывает

И после нескольких очень меня прокачавших лет работы топом случился кризис смыслов: работать я могу в любой компании, но влиять только на нее мне стало недостаточно. Решение не заставило себя долго ждать, потому что зрело уже много лет. Я собрал топ задач, решаемых в бизнесе с помощью ML, покрасил их грубо в черное и белое - где экономика расходится, где сходится, а где эффект не стоит того, чтобы пытаться. И прямо по этому списку составил вместе с Никитой Зелинским курс из прикладных задач, которые регулярно возникают везде: в телекоме, финтехе, ритейле, e-commerce, райдтехе, классическом айти с многопользовательскими приложениями и много где еще. Зачем? Чтобы теперь замашинлернить не одну компанию, не один холдинг, а все, до чего дотягивается солнце на рассвете - ну помните, как в "Короле льве" :))

ЧТО БЫЛО ДАЛЬШЕ:

🧠Мы обкатали этот курс на студентах двух топовых вузов России - МФТИ и НИУ ВШЭ

🏟Мы взяли полгода на его доработку и адаптацию к более широкому кругу слушателей

🎉Мы подготовили курс к запуску в моей онлайн-школе MLinside

Завтра мы с Никитой ведем вебинар перед стартом курса. Еще не поздно зарегистрироваться и попасть на первый поток. В этом случае вы первым:

1️⃣Научитесь решать не только свою задачу, с которой сидите последний год/два/три на работе

2️⃣Станете востребованным ML специалистом в любой компании: если не все, то больше половины изученных на курсе задач будет в ней применимо

3️⃣Получите буквально за несколько месяцев выжимку того опыта, который мы с Никитой собирали по крупицам в больших экосистемах больше десяти лет

‼️Присоединяйтесь к нам, будет круто :)

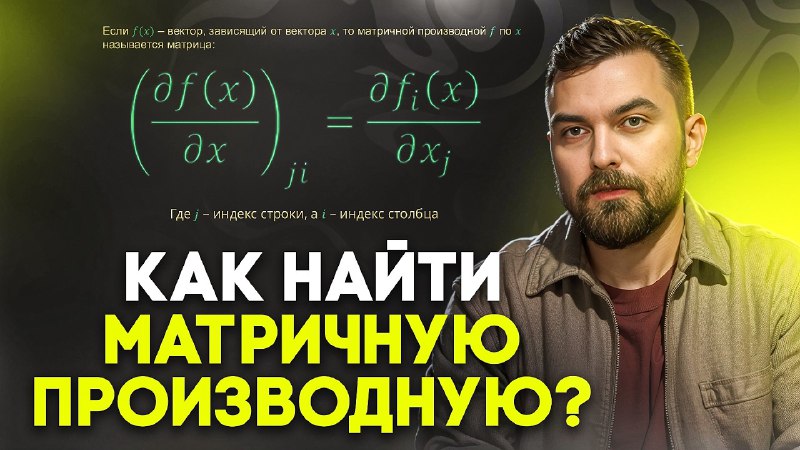

Матричное дифференцирование

😱 В ML периодически возникает потребность взять производную от матричного выражения, как правило имеющую вид «производная вектора по вектору». Если вас всегда ломало разобраться с матричным дифференцированием, а строгое формальное изложение матричных производных через дифференциалы вводило в уныние, я недавно записал видео с простым объяснением, как это работает.

🎭 В ролике есть определенная драматургия: будет момент, где мы с вами сами начнем придумывать матричную производную так, чтобы она в частном случае превращалась в уже привычный нам градиент. И оттуда станет ясно, почему матричная производная именно такая, а не, например, транспонированная.

🤓 Всем, кто хочет шарить за ML чуть глубже, чем «ну я тут что-то обучил и в докер завернул, а как работает не мое дело» - рекомендую к просмотру. Жить без матричных производных можно, но компактно оперировать формулами очень удобно.

В четверг проводим вебинар перед запуском курса ML в бизнесе. В курсе разбираем с Никитой топ 7 задач по экономическому эффекту от ML для бизнеса

Крик души про оценку качества рекламы по попаданию в пол-возраст

Иногда Data Scientist’ы в тг не боятся писать лютую базу. А тут даже не база, а целый генштаб.

Тоже горит с этого наяривания на пол-возраст вместо прямого прогнозирования отклика и замера его качества. А уж оценка попадания по панелистам или по Яндекс.Метрике по принципу «если даже такую простую задачу плохо решите, то куда вам до response моделей» - просто полыхание всего, что плохо сидит))

Еще не поздно присоединиться :)

Первая группа получит больше всего внимания от преподавателей и максимальную кастомизацию курса. Все ваши запросы рассказать что-нибудь еще раз, добавить какое-нибудь задание или новую тему будут обработаны, домашки будут отсматриваться проверяющими, и по домашкам конечно же будет фидбек. Так что если хотите приобщиться к машинному обучению - самый подходящий момент ?

А по-моему отличные новости. Гораздо неприятнее будет узнать, что начальство или эйчар в компании очень своеобразны, уже устроившись на работу. Путь эта практика распространяется как можно скорее ?? Будет всё сразу понятно :)

Статзначимость в А/В тестах: дополнительные вопросы (часть 3/3)

Я слышал, что p-value — это не вероятность нулевой гипотезы, что это значит?

Все верно, это известная бородатая ошибка при интерпретации p-value. P-value — это не вероятность нулевой гипотезы, а вероятность увидеть в тесте такой же «эффект» или больше, при условии справедливости нулевой гипотезы (т.е. когда эффекта на самом деле нет). От этого можно перейти к вероятности нулевой гипотезы, при условии наблюдаемого эффекта по теореме Байеса, если вдруг вы будете знать все нужные для формулы вероятности, но нужды в этом нет.

А еще я слышал, что нулевую гипотезу нельзя принять, о чем это?

В А/В тесте мы хотим отвергнуть нулевую гипотезу, посмотрев на фактические данные. Но можем не отвергнуть. Подтвердить нулевую гипотезу не можем: если нам не хватает свидетельств против чего-то, это еще не значит, что это что-то верно ?

Бытовая иллюстрация:

Старушка на лавочке у подъезда выбирает, как поприветствовать Васю. В качестве нулевой гипотезы она принимает утверждение, что Вася обычный парень. А в качестве альтернативы — что Вася наркоман. Чтобы выбрать доброжелательное или агрессивное приветствие, она оценивает, насколько Вася плохо выглядит сегодня. Если «еще терпимо», то заключает, что свидетельств против нулевой гипотезы не хватает и нужно приветствовать доброжелательно. В этом случае она, однако, не может быть уверена, что Вася не наркоман, т.е. принять нулевую гипотезу. Но как вдумчивая и образованная пожилая женщина, не спешит с выводами и собирает данные.

Везде выше постоянно говорилось о каком-то статистическом различии между результатами в группах А/В, которое либо есть, либо нет. А что это значит?

Вот здесь мы вступаем на территорию более сложных формулировок. Если объяснять это не на бытовом уровне, то вы сами выбираете смысл «статистического различия» при формулировке нулевой гипотезы и альтернативы. Например, если мы сравниваем средние чеки в группах А и В, то под «статистически неразличимыми» результатами мы можем иметь ввиду одинаковое матожидание среднего чека в группе А и в группе В. Это будет нулевой гипотезой. Альтернативой — различные матожидания. Есть критерии, которые в качестве нулевой гипотезы рассматривают совпадение медиан распределений или просто совпадение распределений.

А еще слышал что-то про множественную проверку гипотез? Это о чем?

Это о том, что если вы проверяете одновременно несколько гипотез на уровне значимости, скажем, 5% каждая (например, оцениваете эффект сразу и на средний чек, и на конверсию в покупку, и на конверсию в переход на страницу товара), то шанс ложного срабатывания теста хотя бы для одной гипотезы будет уже не 5%, а существенно больше. Есть разные способы учитывать этот эффект.

А всех, кто хочет погрузиться глубже (например, узнать, как быть, если наблюдения в А/В тесте зависимые, и причем здесь бакетное сэмплирование), а также познакомиться и с AB тестами, и с методами машинного обучения - приглашаю на наш курс «База ML»

Architec.Ton is a ecosystem on the TON chain with non-custodial wallet, swap, apps catalog and launchpad.

Main app: @architec_ton_bot

Our Chat: @architec_ton

EU Channel: @architecton_eu

Twitter: x.com/architec_ton

Support: @architecton_support

Last updated 1 month ago

Канал для поиска исполнителей для разных задач и организации мини конкурсов

Last updated 1 month, 3 weeks ago